在上一篇《基于ONNX的Web端YOLOv8模型部署与推理》的最后,我写了一些改进措施,其中有提到“调用端侧设备的GPU资源,来加速浏览器中模型的推理”,之后自己就一直在思考和尝试这方面的技术方案。本文描述了基于tensorflow.js的代码实现,通过在端侧(PC、mobile)浏览器中启用WebGPU backend,达到了模型推理速度的显著提升。

基于ONNX的Web端YOLOv8模型部署与推理

之前的一些实验,主要集中在模型的搭建、训练和调优上,没有涉及部署的环节,所以这次尝试将模型部署到端侧设备(浏览器),来熟悉一下部署的流程。

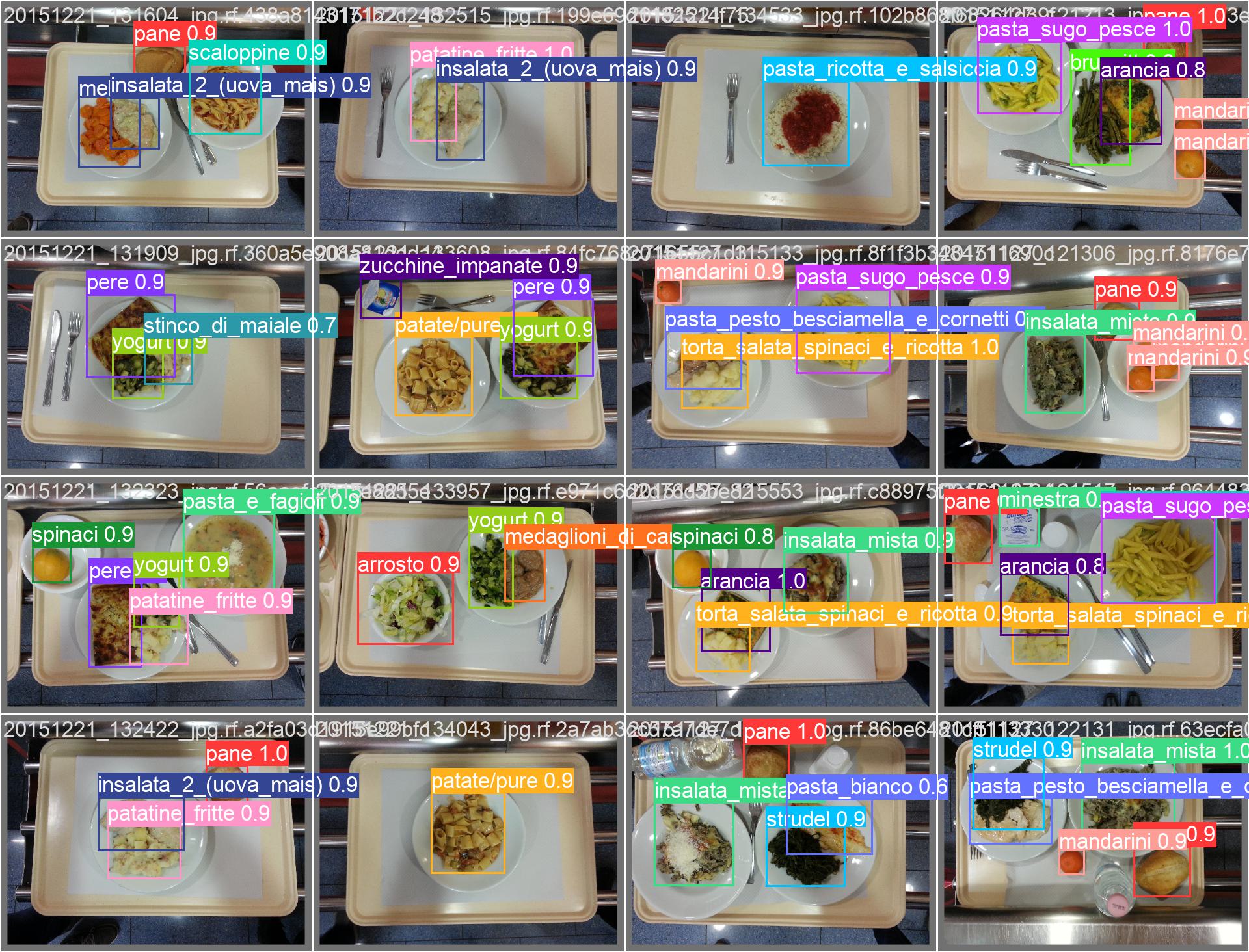

基于YOLOv8的菜品检测实验

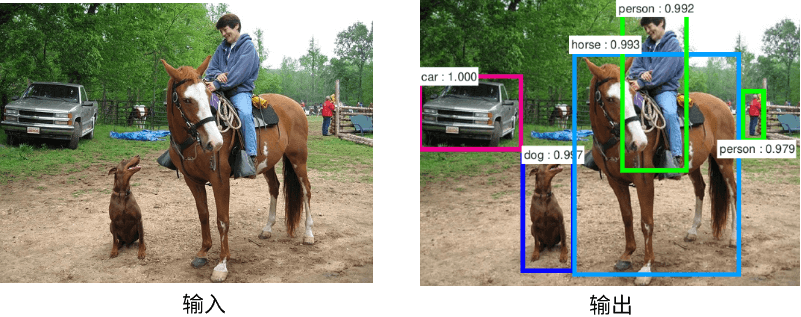

目标检测之Faster R-CNN原理

基于CNN的水果分类与模型调优实验

MySQL 基础操作

为什么我不再选择前端

前端是一个追求美的行当:漂亮的交互、丰富的特效、灵活多变的呈现形态,似乎总是能很好得迎合用户的喜欢和口味。但凡事都有两面性,追求美往往是有代价的。

socket-io demo

1.consts.js

1 | export const DEFAULT_OPTIONS = { reconnectionAttempts: 10, transports: ["websocket"] }; |

使用Doppler和PDM应用的Dockerfile示例

1 | # build stage |